هوش مصنوعی در سال ۱۹۵۶ میلادی تبدیل به شاخهای آکادمیک شد و در سالهای پس از آن چندین موج خوشبینی را تجربه کرده و مجدد دچار امواج ناامیدی و کمبود بودجه شده (که به آن «زمستان AI» میگویند)، سپس فناوریهای جدیدی در پی آن آمده و موفقیت و بودجههای تحقیقاتی این حوزه مجدداً احیا گشتهاند. تحقیقات AI رهیافتهای متفاوتی را از زمان تأسیسش امتحان کرده و آنها را کنار گذاشته است، رهیافتهایی چون: شبیهسازی مغز، مدلسازی حل مسئله توسط مغز انسان، منطق صوری، بانکهای اطلاعاتی بزرگ دانش و تقلید رفتار جانوران. در اولین دهههای قرن ۲۱ میلادی، یادگیری ماشینی که شدیداً از آمار ریاضیاتی بهره میبرد در این حوزه غلبه داشت و این فناوری اثبات کرد که به شدت موفق است و به حل چندین مسئله چالشبرانگیز در صنعت و فضای آکادمیک کمک نمود.[۷][۸]

شاخههای مختلف تحقیقات هوش مصنوعی حول اهداف بهخصوصی متمرکز بوده و از ابزارآلات خاصی استفاده میکنند. اهداف سنتی تحقیقات AI شامل این موارد اند: استدلال، نمایش دانش، برنامهریزی، یادگیری، پردازش زبان طبیعی، ادراک و توانایی در جابجایی و دستکاری اشیاء.[ت] هوش جامع (توانایی حل مسائل دلخواه) در میان اهداف بلند مدت این حوزه است. جهت حل چنین مسائلی، محققان AI فنون حل مسئله وسیع و یکپارچهای را شامل این موارد به کار بستهاند: جستوجو و بهینهسازی ریاضیاتی، منطق صوری، شبکههای عصبی مصنوعی و روشهای مبنی بر آمار، احتمالات و اقتصاد. AI همچنین با حوزههایی چون علوم کامپیوتر، روانشناسی، زبانشناسی، فلسفه و بسیاری از حوزههای دیگر مرتبط است.[۹]

این شاخه بر این فرض بنا شده است که هوش انسانی «را میتوان به دقت توصیف نمود، به طوری که میتوان آن را توسط یک ماشین شبیهسازی نمود».[ث] این فرض بحثهای فلسفی را پیرامون ذهن و اخلاقیات خلق موجودات هوشمند برانگیخته است، موجوداتی که دارای هوش شبیه-انسان اند. این مسائل توسط افسانهها، داستانهای تخیلی و فلسفه از زمانهای باستان مورد کاوش واقع شدهاند. ادبیات علمی-تخیلی و آیندهپژوهی نیز پیشنهاد میدهند که AI با پتانسیل و قدرت عظیمی که دارد، ممکن است منجر به ایجاد ریسک وجودی برای بشریت گردد.[۱۱]

اهداف

[ویرایش]

مسئله کلی شبیهسازی (یا ایجاد) هوش به زیرمسئلههایی تقسیم شده است. این زیرمسئلهها شامل ویژگیها یا قابلیتهای خاصی هستند که پژوهشگران انتظار دارند یک سیستم هوشمند از خود نشان دهد. ویژگیهای توصیف شده در زیر بیشترین توجه را به خود جلب کرده و دامنه پژوهشهای هوش مصنوعی را پوشش میدهند.[ت]

استدلال و حل مسئله

[ویرایش]

پژوهشگران اولیه الگوریتمهایی را توسعه دادند که از استدلال گام به گامی که انسانها هنگام حل معماها یا انجام استنتاجهای منطقی به کار میبرند، تقلید میکرد.[۱۲] در اواخر دهه ۱۹۸۰ و ۱۹۹۰، روشهایی برای مواجهه با اطلاعات نامطمئن یا ناقص با استفاده از مفاهیم احتمالات و اقتصاد توسعه یافت.[۱۳]

بسیاری از این الگوریتمها برای حل مسائل بزرگ استدلالی ناکافی هستند زیرا با یک «انفجار ترکیبی» مواجه میشوند: با بزرگتر شدن مسائل، سرعت آنها به صورت نمایی کاهش مییابد.[۱۴] حتی انسانها نیز به ندرت از استنتاج گام به گامی که پژوهشهای اولیه هوش مصنوعی میتوانستند مدلسازی کنند، استفاده میکنند. آنها بیشتر مسائل خود را با استفاده از قضاوتهای سریع و شهودی حل میکنند.[۱۵] استدلال دقیق و کارآمد یک مسئله حلنشده باقی مانده است.

بازنمایی دانش

[ویرایش]

یک هستانشناسی دانش را به عنوان مجموعهای از مفاهیم در یک دامنه و روابط بین آن مفاهیم بازنمایی میکند.

بازنمایی دانش و مهندسی دانش[۱۶] به برنامههای هوش مصنوعی اجازه میدهند تا به طور هوشمندانه به سؤالات پاسخ دهند و در مورد حقایق دنیای واقعی استنتاج کنند. بازنماییهای دانش رسمی در نمایهسازی و بازیابی مبتنی بر محتوا،[۱۷] تفسیر صحنه،[۱۸] پشتیبانی تصمیمگیری بالینی،[۱۹] کشف دانش (استخراج «استنتاجهای جالب» و قابل اقدام از پایگاههای داده بزرگ)،[۲۰] و سایر حوزهها استفاده میشوند.[۲۱]

یک پایگاه دانش مجموعهای از دانش است که به شکلی قابل استفاده برای یک برنامه بازنمایی شده است. یک هستی شناسی مجموعهای از اشیاء، روابط، مفاهیم و ویژگیهایی است که توسط یک دامنه خاص از دانش استفاده میشود.[۲۲] پایگاههای دانش نیاز به بازنمایی مواردی مانند اشیاء، ویژگیها، دستهها و روابط بین اشیاء دارند؛[۲۳] موقعیتها، رویدادها، وضعیتها و زمان؛[۲۴] علل و معلولها؛[۲۵] دانش در مورد دانش (آنچه ما در مورد آنچه دیگران میدانند، میدانیم)؛[۲۶] استدلال پیشفرض (چیزهایی که انسانها فرض میکنند درست هستند تا زمانی که خلاف آن به آنها گفته شود و حتی با تغییر حقایق دیگر نیز درست باقی میمانند)؛[۲۷] و بسیاری از جنبهها و دامنههای دیگر دانش.

از جمله دشوارترین مسائل در بازنمایی دانش، گستردگی دانش عقل سلیم (مجموعه حقایق اتمی که یک فرد معمولی میداند بسیار گسترده است)؛[۲۸] و شکل زیر-نمادین بیشتر دانش عقل سلیم (بسیاری از آنچه مردم میدانند به صورت «حقایق» یا «گزارههایی» که بتوانند به صورت کلامی بیان کنند، بازنمایی نمیشود) است.[۱۵] همچنین دشواری فراگیری دانش، یعنی مسئله به دست آوردن دانش برای کاربردهای هوش مصنوعی، وجود دارد.[ج]

برنامهریزی و تصمیمگیری

[ویرایش]

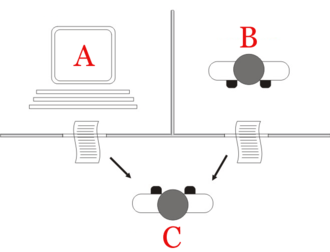

یک «عامل» (agent) هر چیزی است که در جهان ادراک کرده و اقداماتی را انجام میدهد. یک عامل منطقی اهداف یا ترجیحاتی دارد و برای تحقق آنها اقدام میکند.[چ][۳۱] در برنامهریزی خودکار، عامل یک هدف مشخص دارد.[۳۲] در تصمیمگیری خودکار، عامل ترجیحاتی دارد—موقعیتهایی وجود دارند که ترجیح میدهد در آنها باشد و موقعیتهایی که سعی میکند از آنها اجتناب کند. عامل تصمیمگیرنده به هر موقعیت یک عدد (که «مطلوبیت» نامیده میشود) اختصاص میدهد که میزان ترجیح عامل را برای آن موقعیت اندازهگیری میکند. برای هر اقدام ممکن، میتواند «مطلوبیت انتظاری» را محاسبه کند: یعنی مطلوبیت تمام نتایج ممکن از آن اقدام، که با احتمال وقوع آن نتیجه وزندهی شده است. سپس میتواند اقدامی را انتخاب کند که بیشترین مطلوبیت انتظاری را داشته باشد.[۳۳]

در برنامهریزی کلاسیک، عامل دقیقاً میداند که تأثیر هر اقدام چه خواهد بود.[۳۴] ولی در بیشتر مسائل دنیای واقعی، عامل ممکن است در مورد موقعیتی که در آن قرار دارد مطمئن نباشد (موقعیت «ناشناخته» یا «غیرقابل مشاهده» است) و ممکن است به طور قطع نداند که پس از هر اقدام ممکن چه اتفاقی خواهد افتاد (موقعیت «قطعی» نیست). عامل باید با یک حدس احتمالی اقدامی را انتخاب کند و سپس موقعیت را دوباره ارزیابی کند تا ببیند آیا اقدام مؤثر بوده است یا خیر.[۳۵]

در برخی مسائل، ترجیحات عامل ممکن است نامشخص باشد، به خصوص اگر عوامل یا انسانهای دیگری درگیر باشند. این ترجیحات میتوانند یاد گرفته شوند (مثلاً با یادگیری تقویتی معکوس) یا عامل میتواند برای بهبود ترجیحات خود به دنبال اطلاعات باشد.[۳۶] نظریه ارزش اطلاعات میتواند برای سنجش ارزش اقدامات اکتشافی یا آزمایشی استفاده شود.[۳۷] فضای اقدامات و موقعیتهای ممکن در آینده معمولاً به طور ذاتی بزرگ است، بنابراین عاملها باید در حالی که از نتیجه مطمئن نیستند، اقدام کرده و موقعیتها را ارزیابی کنند.

یک فرایند تصمیمگیری مارکوف دارای یک مدل انتقال است که احتمال تغییر حالت توسط یک اقدام خاص به روشی معین را توصیف میکند و یک تابع پاداش دارد که مطلوبیت هر حالت و هزینه هر اقدام را فراهم میکند. یک سیاست (policy) یک تصمیم را به هر حالت ممکن مرتبط میکند. سیاست میتواند محاسبه شود (مثلاً با تکرار سیاست)، ابتکاری باشد، یا یاد گرفته شود.[۳۸]

نظریه بازیها رفتار منطقی چندین عامل در حال تعامل را توصیف میکند و در برنامههای هوش مصنوعی که تصمیماتی را شامل عوامل دیگر میگیرند، استفاده میشود.[۳۹]

یادگیری

[ویرایش]

یادگیری ماشین مطالعه برنامههایی است که میتوانند عملکرد خود را در یک وظیفه معین به طور خودکار بهبود بخشند.[۴۰] این حوزه از ابتدا بخشی از هوش مصنوعی بوده است.[ح]

در یادگیری با نظارت، دادههای آموزشی با پاسخهای مورد انتظار برچسبگذاری شدهاند، در حالی که در یادگیری بدون نظارت، مدل الگوها یا ساختارها را در دادههای بدون برچسب شناسایی میکند.

انواع مختلفی از یادگیری ماشین وجود دارد. یادگیری بینظارت جریانی از دادهها را تحلیل میکند و بدون هیچ راهنمایی دیگری، الگوها را پیدا کرده و پیشبینیهایی را انجام میدهد.[۴۳] یادگیری بانظارت نیازمند برچسبگذاری دادههای آموزشی با پاسخهای مورد انتظار است و در دو نوع اصلی ارائه میشود: دستهبندی (که در آن برنامه باید یاد بگیرد پیشبینی کند ورودی به کدام دسته تعلق دارد) و رگرسیون (که در آن برنامه باید یک تابع عددی را بر اساس ورودی عددی استنتاج کند).[۴۴]

در یادگیری تقویتی، عامل برای پاسخهای خوب پاداش میگیرد و برای پاسخهای بد تنبیه میشود. عامل یاد میگیرد پاسخهایی را انتخاب کند که به عنوان «خوب» طبقهبندی میشوند.[۴۵] یادگیری انتقال زمانی است که دانش به دست آمده از یک مسئله به یک مسئله جدید اعمال میشود.[۴۶] یادگیری عمیق نوعی از یادگیری ماشین است که ورودیها را از طریق شبکههای عصبی مصنوعی الهام گرفته از زیستشناسی برای همه این انواع یادگیری پردازش میکند.[۴۷]

نظریه یادگیری محاسباتی میتواند یادگیرندهها را بر اساس پیچیدگی محاسباتی، پیچیدگی نمونه (چه مقدار داده مورد نیاز است)، یا مفاهیم دیگر بهینهسازی ارزیابی کند.[۴۸]

پردازش زبان طبیعی

[ویرایش]

پردازش زبان طبیعی (پزط) به برنامهها اجازه میدهد تا به زبانهای انسانی بخوانند، بنویسند و ارتباط برقرار کنند.[۴۹] مسائل خاص شامل بازشناسی گفتار، تولید گفتار، ترجمه ماشینی، استخراج اطلاعات، بازیابی اطلاعات و پرسش و پاسخ است.[۵۰]

کارهای اولیه، بر اساس دستور زایشی نوآم چامسکی و شبکههای معنایی، با ابهامزدایی از معنای واژه مشکل داشتند[خ] مگر اینکه به دامنههای کوچکی به نام «میکرو-جهانها» محدود میشدند (به دلیل مسئله دانش عقل سلیم[۲۸]). مارگارت مسترمن معتقد بود که معنا و نه دستور زبان، کلید درک زبانها است و اصطلاحنامه و نه لغتنامهها باید اساس ساختار زبان محاسباتی باشند.

تکنیکهای مدرن یادگیری عمیق برای NLP شامل تعبیه کلمه (نمایش کلمات، معمولاً به صورت بردارها که معنای آنها را رمزگذاری میکنند)،[۵۱] ترنسفورمرها (یک معماری یادگیری عمیق با استفاده از مکانیزم توجه)،[۵۲] و موارد دیگر است.[۵۳] در سال ۲۰۱۹، مدلهای زبانی ترنسفورمر از پیش آموزشدیده مولد (یا "GPT") شروع به تولید متن منسجم کردند،[۵۴][۵۵] و تا سال ۲۰۲۳، این مدلها توانستند در آزمون وکالت، آزمون SAT، آزمون GRE و بسیاری از کاربردهای دنیای واقعی دیگر، نمراتی در سطح انسان کسب کنند.[۵۶]

ادراک

[ویرایش]

ادراک ماشین توانایی استفاده از ورودیهای حسگرها (مانند دوربینها، میکروفونها، سیگنالهای بیسیم، لیدار فعال، سونار، رادار و حسگرهای لمسی) برای استنتاج جنبههایی از جهان است. بینایی رایانهای توانایی تحلیل ورودی بصری است.[۵۷]

این حوزه شامل بازشناسی گفتار،[۵۸] دستهبندی تصویر،[۵۹] بازشناسی چهره، بازشناسی اشیاء،[۶۰] ردیابی اشیاء،[۶۱] و ادراک رباتیک است.[۶۲]

هوش اجتماعی

[ویرایش]

کیزمت، یک سر ربات که در دهه ۱۹۹۰ ساخته شد؛ ماشینی است که میتواند احساسات را تشخیص داده و شبیهسازی کند.[۶۳]

رایانش عاطفی حوزهای است که شامل سیستمهایی میشود که احساس، هیجان و خلقوخوی انسان را تشخیص میدهند، تفسیر میکنند، پردازش میکنند یا شبیهسازی میکنند.[۶۴] به عنوان مثال، برخی دستیاران مجازی طوری برنامهریزی شدهاند که به صورت محاورهای صحبت کنند یا حتی شوخی کنند؛ این باعث میشود آنها نسبت به دینامیکهای عاطفی تعامل انسانی حساستر به نظر برسند یا تعامل انسان و رایانه را تسهیل کنند.

با این حال، این امر تمایل دارد به کاربران سادهلوح یک تصور غیرواقعی از هوش عاملهای کامپیوتری موجود بدهد.[۶۵] موفقیتهای متوسط مرتبط با رایانش عاطفی شامل تحلیل احساسات متنی و اخیراً تحلیل احساسات چندوجهی است که در آن هوش مصنوعی عواطف نمایش داده شده توسط یک سوژه فیلمبرداری شده را طبقهبندی میکند.[۶۶]

هوش عمومی

[ویرایش]

یک ماشین با هوش مصنوعی عمومی قادر خواهد بود طیف گستردهای از مسائل را با گستردگی و تطبیقپذیری مشابه هوش انسانی حل کند.[۶۷]

تاریخچه

[ویرایش]

مقالهٔ اصلی: تاریخ هوش مصنوعی

هوش مصنوعی توسط فلاسفه و ریاضیدانانی نظیر جرج بول که اقدام به ارائهٔ قوانین و نظریههایی در مورد منطق نمودند، مطرح شده بود. با اختراع رایانههای الکترونیکی در سال ۱۹۴۳، هوش مصنوعی، دانشمندان آن زمان را به چالشی بزرگ فراخواند. در این شرایط، چنین بهنظر میرسید که این فناوری قادر به شبیهسازی رفتارهای هوشمندانه خواهد بود.

با وجود مخالفت گروهی از اندیشمندان با هوش مصنوعی که با تردید به کارآمدی آن مینگریستند، تنها پس از چهار دهه، ماشینهای شطرنجباز و دیگر سامانههای هوشمند پرورشیافته را میتوان در صنایع گوناگون دید.

شاخهٔ پژوهش در زمینهٔ هوش مصنوعی در یک کارگاه آموزشی در کالج دارتموث در سال ۱۹۵۶ متولد شد.[۶۸][۶۹][۷۰] شرکتکنندگان آلن نیول (دانشگاه کارنگی ملون)، هربرت سیمون (دانشگاه کارنگی ملون)، جان مککارتی (مؤسسه فناوری ماساچوست)، ماروین منسکی (مؤسسه فناوری ماساچوست) و آرتور ساموئل (آیبیام) از بنیانگذاران و رهبران پژوهش در زمینهٔ هوش مصنوعی شدند.[۶۸] آنها به همراه دانشجویانشان برنامههایی نوشتند که مطبوعات آن را «شگفتآور» توصیف میکردند، رایانهها استراتژیهای بردِ بازی چکرز را فرا میگرفتند،[۷۱][۷۲] سوالاتی در جبر حل میکردند، قضیههای منطقی اثبات میکردند و انگلیسی صحبت میکردند.[۶۸][۷۳] در اواسط دهه ۱۹۶۰ میلادی وزارت دفاع آمریکا سرمایهگذاریهای سنگینی در حوزه پژوهش در زمینه هوش مصنوعی انجام میداد،[۶۹] در آن دهه آزمایشگاههای فراوانی در سراسر جهان تأسیس شد.[۷۴] بنیانگذاران هوش مصنوعی در مورد آینده خوشبین بودند: هربرت سیمون پیشبینی کرد «ماشینها ظرف بیست سال قادر به انجام هر کاری هستند که یک انسان میتواند انجام دهد». ماروین مینسکی، نوشت: «در طی یک نسل … مسئله هوش مصنوعی اساساً حل خواهد شد».[۶۹]

نام هوش مصنوعی در سال ۱۹۶۵ میلادی به عنوان یک دانش جدید ابداع گردید. البته فعالیت در این زمینه از سال ۱۹۶۰ میلادی شروع شد. (مرجع۱) بیشتر کارهای پژوهشی اولیه در هوش مصنوعی بر روی انجام ماشینی بازیها و نیز اثبات قضیههای ریاضی با کمک رایانهها بود. در آغاز چنین به نظر میآمد که رایانهها قادر خواهند بود چنین فعالیتهایی را تنها با بهره گرفتن از تعداد بسیار زیادی کشف و جستجو برای مسیرهای حل مسئله و سپس انتخاب بهترین روش برای حل آنها به انجام رسانند.

اصطلاح هوش مصنوعی برای اولین بار توسط جان مککارتی (که از آن بهعنوان پدر علم و دانش تولید ماشینهای هوشمند یاد میشود) استفاده شد. وی مخترع یکی از زبانهای برنامهنویسی هوش مصنوعی به نام لیسپ (به انگلیسی: lisp) است. با این عنوان میتوان به هویت رفتارهای هوشمندانه یک ابزار مصنوعی پی برد. (ساختهٔ دست بشر، غیرطبیعی، مصنوعی) حال آنکه هوش مصنوعی به عنوان یک اصطلاح عمومی پذیرفته شده که شامل محاسبات هوشمندانه و ترکیبی (مرکب از مواد مصنوعی) است.

از اصطلاح "Strong and Weak AI" میتوان تا حدودی برای معرفی ردهبندی سامانهها استفاده کرد.

آزمون تورینگ

[ویرایش]

آزمون تورینگ

آزمون تورینگ[۷۵] آزمونی است که توسط آلن تورینگ در سال ۱۹۵۰ در نوشتهای به نام «محاسبات و هوشمندی» مطرح شد. در این آزمون شرایطی فراهم میشود که شخصی با ماشینی تعامل برقرار کند و پرسشهای کافی برای بررسی اقدامات هوشمندانهٔ ماشین، از آن بپرسد. چنانچه در پایان آزمایش نتواند تشخیص دهد که با انسان یا با ماشین در تعامل بوده است، آزمون با موفقیت انجام شده است. تاکنون هیچ ماشینی از این آزمون با موفقیت بیرون نیامده است. کوشش این آزمون برای تشخیص درستی هوشمندی یک سامانه است که سعی در شبیهسازی انسان دارد.

تعریف و طبیعت هوش مصنوعی

[ویرایش]

سامانه یک خودروی بدون راننده میتواند از یک شبکه عصبی استفاده کند تا بتواند تشخیص دهد که کدام قسمت از تصاویر میتواند با تصویر یک انسان تطابق داده شود، و سپس آن قسمت را به شکل یک مستطیل با حرکت آهسته شبیهسازی کند که باید از برخورد با آن خودداری شود.[۷۶][۷۷]

هنوز تعریف دقیقی برای هوش مصنوعی که مورد توافق دانشمندان این علم باشد ارائه نشده است و این به هیچ وجه مایهٔ تعجب نیست. چرا که مقولهٔ مادر و اساسیتر از آن، یعنی خود هوش هم هنوز بهطور همهجانبه و فراگیر تن به تعریف نداده است. در واقع میتوان نسلهایی از دانشمندان را سراغ گرفت که تمام دوران زندگی خود را صرف مطالعه و تلاش در راه یافتن جوابی به این سؤال عمده نمودهاند که: هوش چیست؟

ولی بیشتر تعریفهایی که در این زمینه داده شدهاست، بر پایهٔ یکی از ۴ باور زیر است:

- سامانههایی که منطقی میاندیشند.

- سامانههایی که منطقی کار میکنند.

- سامانههایی که مانند انسان میاندیشند.

- سامانههایی که مانند انسان کار میکنند. (مرجع۱)

میتوان هوش مصنوعی را اینگونه توصیف کرد: «هوش مصنوعی عبارت است از مطالعه این که چگونه رایانهها را میتوان وادار به کارهایی کرد که در حال حاضر انسانها آنها را صحیح یا بهتر انجام میدهند» (مرجع۲). هوش مصنوعی به هوشی که یک ماشین از خود نشان میدهد یا به دانشی در رایانه که میکوشد آن را پدید آورد گفته میشود. بیشتر نوشتهها و مقالههای مربوط به هوش مصنوعی آن را «دانش شناخت و طراحی عاملهای هوشمند» تعریف کردهاند. یک عامل هوشمند، ساماندهی است که با شناخت محیط اطراف خود، شانس موفقیت خود را بالا میبرد.

اینکه هوش مصنوعی چیست و چه تعریفی میتوان از آن بیان نمود؟ مبحثی است که تاکنون دانشمندان به یک تعریف جامع در آن نرسیدهاند و هریک تعریفی را ارائه نمودهاند که در زیر نمونهای از این تعاریف آمده است.

- هنر ایجاد ماشینهایی که وظایفی را انجام میدهند که انجام آنها توسط انسانها نیاز به هوش دارد (کورزویل - ۱۹۹۰)

- مطالعهٔ استعدادهای ذهنی از طریق مدلهای محاسباتی (کارنیاک و مک درموت - ۱۹۸۵)

- مطالعهٔ اینکه چگونه رایانهها را قادر به انجام اعمالی کنیم که در حال حاضر، انسان آن اعمال را بهتر انجام میدهد. (ریچ و نایت - ۱۹۹۱)

- خودکارسازی فعالیتهایی که ما آنها را به اندیشش انسانی نسبت میدهیم. فعالیتهایی مثل تصمیمگیری، حل مسئله، یادگیری و … (بلمن - ۱۹۷۸)

- کوششی نو و مهیج برای اینکه رایانهها را دارای اندیشیدن کنیم. ماشینهایی با اندیشه و حس تشخیص واقعی (هاگلند - ۱۹۸۵)

- یک زمینهٔ تخصصی که به دنبال توضیح و شبیهسازی رفتار هوشمندانه به وسیلهٔ فرایندهای رایانهای است. (شالکوف - ۱۹۹۰)

- مطالعه محاسباتی که درک، استدلال و عمل کردن را توسط ماشینها را ممکن میسازد. (وینستون - ۱۹۹۲)

- توانایی دست یافتن به کارایی در حد انسان در همهٔ امور شناختی توسط رایانه (آلن تورینگ - ۱۹۵۰)

- هوش مصنوعی دانش و مهندسی ساخت ماشینهای هوشمند و به خصوص برنامههای رایانهای هوشمند است. هوش مصنوعی با وظیفه مشابه استفاده از رایانهها برای فهم چگونگی هوش انسان مرتبط است، ولی مجبور نیست خودش را به روشهایی محدود کند که بیولوژیکی باشند. (جان مککارتی - ۱۹۸۰)

هوشمندی مفهومی نسبی دارد و نمیتوان محدوده صحیحی را برای ارائه تعریف از آن مشخص نمود. رفتاری که از نظر یک فرد هوشمند به نظر میرسد؛ ممکن است برای یک فرد دیگر اینگونه به نظر نرسد. ولی در مجموع خصوصیات زیر قابلیتهای ضروری برای هوشمندی است:

- پاسخ به موقعیتهای از قبل تعریف نشده با انعطاف بسیار بالا و بر اساس بانک دانش

- معنا دادن به پیامهای نادرست یا مبهم

- درک تمایزها و شباهتها

- تجزیه و تحلیل اطلاعات و نتیجهگیری

- توانمندی آموختن و یادگرفتن

- برقراری ارتباط دوطرفه

به فرض اینکه تعاریف بالا را از هوشمندی بپذیریم، موارد زیر فهرستی است از وظایفی که از یک سامانه هوشمند انتظار میرود و تقریباً اکثر دانشمندان هوش مصنوعی بر آن توافق نظر دارند به شرح زیر است:

- تولید گفتار

- تشخیص و درک گفتار (پردازش زبان طبیعی انسان)

- دستورپذیری و قابلیت انجام اعمال فیزیکی در محیط طبیعی و مجازی

- استنتاج و استدلال

- تشخیص الگو و بازشناسی الگو برای پاسخ گویی به مسائل بر اساس دانش قبلی

- شمایلی گرافیکی یا فیزیکی جهت ابراز احساسات و عکسالعملهای ظریف

- سرعت عکسالعمل بالا

رویکردهای اصلی به هوش مصنوعی

[ویرایش]

رویکردهای شاخص به هوش مصنوعی[۷۸] (به ترتیب روند زمانی که مطرح شدند و البته همگی سپس به بقا در حیطه خودشان ادامه دادند):

1- مبتنی بر منطق و Rule[۷۹]

2- مبتنی بر تشخیص الگو / روشهای احتمالاتی / روشهای آماری[۸۰]

3- مبتنی بر الگوریتمهای مکاشفه ای (Heuristics)[۸۱]

4- مبتنی بر گرافهای دانش و هستانشناسیها

5- مبتنی بر هوش مصنوعی عامل گرا [۸۲] [۸۳] و عامل های دیجیتالی[۸۴]

6- مبتنی بر شبیه سازی رخدادها / مولدهای رخداد

7- مبتنی بر یادگیری ماشین

8- مبتنی بر شبکههای عصبی عمیق[۸۵]

9- مبتنی بر GAN و Transformers و Encoders و Decoders و هوش مصنوعی مولد (Generative AI)

10- مبتنی بر مدلهای بزرگ آموزش داده شده

11- مبتنی بر مدلهای بزرگ زبانی LLM

12- مبتنی بر دستوردهی به LLMها (یعنی Prompt Engineering)

13- هوش مصنوعی توضیح پذیر (XAI) / اعتماد پذیر / مسئول / جویا (RAG)

14- هوش مصنوعی ارزان و بهره ور (مانند کاهش مصرف انرژی در مدارهای هوش مصنوعی با استفاده از سخت افزارهای فوتونیکی)[۸۶]

15- هوش مصنوعی انسان وار (Human Like) و معماری شناختی

16- هوش مصنوعی عمومی (AGI)

17- ابرهوش مصنوعی (ASI)

18- هوش مصنوعی مستقل / خودمختار / عامل های خودتجربه گر [۸۷][۸۸]

19- مدل های جهان (World Models) / شبیه سازیِ هوش مصنوعی[۸۹]

20- پارادایم های نامتعارف و نوظهور هوش مصنوعی (مانند شبکه های عصبی کوانتومی، دیگر شیوه های ترکیبی هوش و کوانتوم)[۹۰][۹۱][۹۲][۹۳][۹۴]

21- هوشمندی سیاره ای (سیاره گستر)[۹۵]

22- خِرَد ترکیبی (Hybrid Wisdom)[۹۶][۹۷][۹۸][۹۹]

کاربردهای هوش مصنوعی

[ویرایش]

هوش مصنوعی کاربردهای متنوعی دارد. تعدادی از مهمترین کاربردهای هوش مصنوعی شامل استفاده در وسایل نقلیه خودگردان (مثل پهپادها و اتومبیلهای خودران)، تشخیصهای پزشکی، خلق آثار هنری، اثبات قضیههای ریاضی، انجام بازیهایی بر پایهٔ اندیشه، تعیین هویت تصاویر (تشخیص چهره) و صداها، ذخیره انرژی، جستجوگرهای اینترنتی، تهیه قراردادها و پیشبینی آرای قضایی میشوند.

هوش مصنوعی در اقتصاد

[ویرایش]

یکی از مهمترین کاربردهای هوش مصنوعی در زمینهٔ تجارت، اقتصاد و کلان داده است. برای مثال، با استفاده از هوش مصنوعی میتوان با ضریب خطای پایینی، تغییرات فصلی و بلندمدت در عرضه یا تقاضای محصولات مختلف را پیشبینی کرد. این موضوع میتواند به شدت در سیاست، اقتصاد کلان و کنترل عرضه و تقاضا مفید واقع شود. همچنین، شرکتهایی مانند گوگل خدماتی در زمینهٔ هوش مصنوعی به شرکتهای بزرگ ارائه میدهند که میتواند به برنامهریزی، انبارگردانی، پیشبینی سیر صعودی یا نزولی فروش در محصولات به خصوص و نیز برندسازی آنها کمک کند.

پیشبینی قیمت در بازارها (مانند پیشبینی قیمت نفت با هوش مصنوعی) یکی از کاربردهای هوش مصنوعی در اقتصاد است.[۱۰۰]

هوش مصنوعی در ورزش

[ویرایش]

بهطور تاریخی، پیشبینی فوتبال به انسانهای ماهری وابسته بود که میتوانستند سوابق و وضعیت دو تیم و بازیکنان را تحلیل کنند. با انقلاب دیجیتال، سایتهای شرطبندی کار را برای پیشبینی آسان و آسانتر کردند. ولی حتی ظهور سایتها و شرطبندی آنلاین هم تأثیری در نحوه شرطبندی ایجاد نکرد. همچنان علاقهمندان تلاش میکنند تا وضعیت طرفین و بازیکنان را بررسی کنند. هوش مصنوعی این را تغییر میدهد. اینترنت باعث ظهور سایتها و فرومهایی شد که تیپسترهای شرطبندی فرم معرفی میکنند. با ظهور هوش مصنوعی، فرم شرطبندی میتواند چیزی فراتر از یک محاسبه انسانی باشد و الگوریتمهای یادگیری ماشین، بازی را عوض میکنند.[۱۰۱][۱۰۲]

شبکههای اجتماعی

[ویرایش]

در شبکههای اجتماعی مطرح مانند توئیتر یا اینستاگرام، برای تشخیص الگوهای رفتاری انسانی، جلوگیری از هرزنامه و انتشار محتوای مجرمانه و نیز شناسایی مخاطبان هدف برای تبلیغات، از هوش مصنوعی استفاده میشود. همچنین، برخی از رباتهای شبکهُ اجتماعی بر پایهٔ هوش مصنوعی فعالیت میکنند تا در بالاترین سطوح رفتارهای انسانی را شبیهسازی نمایند.[۱۰۳]

هوش مصنوعی در خدمات حقوقی

[ویرایش]

کاربرد هوش مصنوعی در خدمات حقوقی به سرعت در حال افزایش است و سیستمهای نوین مبتنی بر پردازش زبان طبیعی به تدریج در حال به عهده گرفتن بخشی از وظایف حقوقدانان هستند. نرمافزارهای مبتنی بر تکنولوژی هوش مصنوعی در حال حاضر امکان تهیه قراردادهای دقیق، تحلیل قراردادها و اسناد حقوقی موجود و پیشبینی آرای دادگاهها را فراهم کردهاند.

هوش مصنوعی در فرهنگ، میراث فرهنگی و میراث مکتوب

[ویرایش]

هوش مصنوعی از طریق فناوریها و کاربردهای خود میتواند به توسعه فرهنگ، کاربردها و ابزارهای فرهنگی، حفاظت از میراث فرهنگی و میراث مکتوب یاری برساند. مواردی مانند پردازش زبان طبیعی، جست و جوی معنایی، خوانش رایانشی کتابها، متن کاوی، ایده کاوی، روانکاوی رایانشی، قرآن کاوی رایانشی، مدلهای زبانی بزرگ، نویسه خوانی نوری OCR (برای کتب خطی و قدیمی یا چاپی و جدید)، اکتشافات زبانشناسی، اکتشافات فرهنگی، پایگاههای داده و دادگان مرجع زبانی و فرهنگی و میراثی، دوقلوی دیجیتال برای میراث فرهنگی، دوقلوی دیجیتال برای میراث مکتوب، واقعیت مجازی هوشمند و واقعیت افزوده هوشمند برای میراث فرهنگی و دیگر موارد.

نیروی انسانی و تخصص

[ویرایش]

توسعهٔ هوش مصنوعی نیازمند حضور متخصصان در زمینههای مختلف از جمله علوم رایانه، یادگیری ماشین، علوم داده و اخلاق فناوری است.

هوش مصنوعی و رد پای کربنی

[ویرایش]

هر بار که از هوش مصنوعی استفاده میکنید، رد پای کربنی ایجاد میشود. هوش مصنوعی (مخصوصاً مدلهای بزرگ مثل (ChatGPT، Grok، Gemini، Llama) برای آموزش (Training) و استفاده (Inference) به انرژی الکتریکی عظیمی نیاز دارند که عمدتاً از نیروگاههای زغالسنگی، گازی یا حتی هستهای تأمین میشود. به طور نمونه:

- یک پرسوجو مثلاً یک سؤال از ChatGPT از ۲ تا ۱۰ گرم CO₂، معادل رانندگی ۵۰ متر با ماشین بنزینی است .

- تولید یک تصویر با AI مثل DALL·E یا Midjourney از ۱ گرم تا ۵ گرم CO₂ معادل ۵ دقیقه روشن ماندن لامپ LED می باشد. هوش مصنوعی، در هر پاسخِ کوتاه، دو تا ده گرمِ کربن به باد میسپارد؛ ولی در رقصِ بیتهای دیجیتال، مثل آموزش یک مدل، پانصد تن دودِ کربنی به آسمانِ زمین میدمد. [۱۰۴] [۱۰۵]

فلسفه هوش مصنوعی

[ویرایش]

مقالهٔ اصلی: فلسفه هوش مصنوعی

بهطور کلی ماهیت وجودی هوش به مفهوم جمعآوری اطلاعات، استقراء و تحلیل تجربیات به منظور رسیدن به دانش یا ارائه تصمیم است. در واقع هوش به مفهوم بهکارگیری تجربه به منظور حل مسائل دریافت شده تلقی میشود. هوش مصنوعی علم و مهندسی ایجاد ماشینهایی هوشمند با بهکارگیری از کامپیوتر و الگوگیری از درک هوش انسانی یا حیوانی و نهایتاً دستیابی به مکانیزم هوش مصنوعی در سطح هوش انسانی است.[۱۰۶]

در مقایسهٔ هوش مصنوعی با هوش انسانی میتوان گفت که انسان قادر به مشاهده و تجزیه و تحلیل مسائل در جهت قضاوت و اخذ تصمیم است در حالی که هوش مصنوعی مبتنی بر قوانین و رویههایی از قبل تعبیه شده بر روی کامپیوتر است. در نتیجه علیرغم وجود رایانههای بسیار کارا و قوی در عصر حاضر ما هنوز قادر به پیاده کردن هوشی نزدیک به هوش انسان در ایجاد هوشهای مصنوعی نبودهایم.

بهطور کلّی، هوش مصنوعی را میتوان از زوایای متفاوتی مورد بررسی و مطالعه قرار داد. مابین هوش مصنوعی به عنوان یک هدف، هوش مصنوعی به عنوان یک رشتهٔ تحصیلی دانشگاهی یا هوش مصنوعی به عنوان مجموعهٔ فنون و راهکارهایی که توسط مراکز علمی مختلف و صنایع گوناگون تنظیم و توسعه یافته است، باید تفاوت قائل بود.[۱۰۷]

اتاق چینی

[ویرایش]

اتاق چینی یک آزمایش ذهنی است که اولین بار توسط مقاله جان سرل بهنام «ذهنها، مغزها، و برنامهها» (به انگلیسی: Minds, Brains, and Programs) در مجله «علوم رفتاری و ذهنی» (به انگلیسی: Behavioral and Brain Sciences) در سال ۱۹۸۰ منتشر شد. وی با این سؤال که آیا یک برنامه هوشمند مترجم که توانایی ترجمه از زبان چینی به زبان انگلیسی را دارد، ضرورتی برای فهم موضوع مورد ترجمه دارد یا خیر و با تشبیه ذهن به یک برنامهٔ هوشمند رایانهای این استدلال را در برابر مواضع فلسفی کارکردگرایی و نظریه محاسباتی ذهن که در آنها، ذهن به عنوان یک محاسبهگر یا دستکاری کنندهٔ نماد عمل میکند، قرار داد.[۱۰۸] در واقع نتایج حاصل از آزمایش اتاق چینی حکایت از این دارد که هیچ برنامهای نمیتواند به کامپیوتر ذهن، فهم یا آگاهی بدهد. حال آن برنامه هر آنچه میخواهد هوشمند باشد و باعث شود کامپیوتر همچون انسان رفتار کند. اگر چه این آزمایش در اصل جوابی برای اظهارات محققان هوش مصنوعی بود، ولی این ادعا در برابر اهداف تحقیقات هوش مصنوعی قرار نمیگیرد چرا که این موضوع حدی برای هوشمندی کامپیوتر قائل نیست. همچنین این آزمایش مختص رایانههای دیجیتال است و دامنه آن همه ماشینها نیستند.[۱۰۸]

چگونگی استفاده هوش مصنوعی

[ویرایش]

هوش مصنوعی چگونه استفاده میشود؟

[ویرایش]

بهطور کلی هوش مصنوعی به دو دسته زیر تفکیک میشود:

Narrow AI یا هوش مصنوعی ضعیف: این نوع هوش مصنوعی در یک زمینه محدود عمل میکند و شبیهسازی هوش انسانی است. هوش مصنوعی ضعیف اغلب بر روی یک کار مشخص تعریف میشود و در محدوده تعریفش بسیار عالی عمل میکند. شاید این ماشینها بسیار هوشمند به نظر برسند ولی حقیقت این است که حتی از ابتدائیترین سطوح هوش انسانی هم سادهتر عمل میکنند.

Artificial General Intelligence یا هوش مصنوعی فراگیر: که با عنوان هوش مصنوعی قوی هم شناخته میشود، نوعی از هوش مصنوعی است که بیشتر در فیلمها دیدهایم، مانند رباتهای فیلم Westworld. هوش مصنوعی قوی بسیار شبیه به انسان عمل میکند چنانکه میتواند تواناییهای خود را بر حل مسائلی در حوزههای مختلف به کار بگیرد.[۱۰۹]

برترین سایت ها و پلتفرم های هوش مصنوعی:

۱. OpenAI (با ChatGPT و DALL·E)

شرکت OpenAI یکی از پیشگامان حوزه هوش مصنوعی است که ابزارهایی مثل ChatGPT، DALL·E و Whisper را توسعه میدهد. این فناوری به کاربر امکان تبدیل گفتار به نوشتار، تولید متن و خلق تصاویر از طریق متن را میدهد. هدف اصلی این ابزارها، بهبود ارتباط انسان با ماشین و افزایش بهرهوری در زمینههای گوناگون است. با بهرهگیری از مدلهای پیشرفته یادگیری ماشین، OpenAI امکانات منحصربهفردی را در اختیار توسعهدهندگان و علاقهمندان به فناوری قرار داده است.[۱۱۰]

Google Cloud AI.2

پلتفرم قدرتمند هوش مصنوعی گوگل، مجموعهای کامل از خدمات پیشرفته مثل تحلیل کلانداده و بینایی ماشین، پردازش زبان طبیعی، مدلهای یادگیری عمیق را در اختیار کاربر قرار میدهد. این ابزارها به کسبوکار ما کمک میکند تا پروژههای هوشمند خود را با دقت و سرعت بیشتری توسعه دهند و پیادهسازی کنند.[۱۱۱]

۳. IBM Watson

پلتفرمی پیشرفته برای تحلیل داده است که در حوزههایی مثل آموزش ، سلامت، امور مالی و صنعت کاربرد زیادی دارد. با بهرهگیری از قابلیتهای تحلیلی IBM Watson، سازمانها میتوانند تصمیمگیریهای خود را بهینهسازی کنند و راهکارهای هوشمند و مبتنی بر داده را طراحی کنند.[۱۱۲]

مدیریت پیچیدگی

[ویرایش]

ایجاد و ابداع فنون و تکنیکهای لازم برای مدیریت پیچیدگی را باید به عنوان هستهٔ بنیادین تلاشهای علمی و پژوهشی گذشته، حال و آینده در تمامی زمینههای علوم رایانه و به ویژه در هوش مصنوعی معرفی کرد. شیوهها و تکنیکهای هوش مصنوعی در واقع، برای حل آن دسته از مسائل به وجود آمده است که بهطور سهل و آسان توسط برنامهنویسی تابعی یا شیوههای ریاضی قابل حلّ نبودهاند.[۱۱۳]

در بسیاری از موارد، با پوشانیدن و پنهان ساختن جزئیّات فاقد اهمیت است که بر پیچیدگی فائق میآییم و میتوانیم بر روی بخشهایی از مسئله متمرکز شویم که مهمتر است. تلاش اصلی در واقع، ایجاد و دستیابی به لایهها و ترازهای بالاتر از هوشمندی انتزاع را نشانه میرود تا آنجا که سرانجام، برنامههای رایانهای درست در همان سطحی کار خواهند کرد که خود انسانها رسیدهاند.

به یاری پژوهشهای گستردهٔ دانشمندان علوم مرتبط، هوش مصنوعی تاکنون راه بسیاری پیموده است. در این راستا، تحقیقاتی که بر روی توانایی آموختن زبانها انجام گرفت و همچنین درک عمیق از احساسات، دانشمندان را در پیشبرد این دانش کمک زیادی کرده است. یکی از اهداف متخصصین، تولید ماشینهایی است که دارای احساسات بوده و دست کم نسبت به وجود خود و احساسات خود آگاه باشند. این ماشین باید توانایی تعمیم تجربیات قدیمی خود در شرایط مشابه جدید را داشته و به این ترتیب اقدام به گسترش دامنه دانش و تجربیاتش کند.

برای نمونه ربات هوشمندی که بتواند اعضای بدن خود را به حرکت درآورد، نسبت به این حرکت خودآگاه بوده و با آزمون و خطا، دامنه حرکت خود را گسترش میدهد و با هر حرکت موفقیتآمیز یا اشتباه، دامنه تجربیات خود را وسعت بخشیده و سرانجام راه رفته یا حتی میدود یا به روشی برای جابجا شدن دست مییابد که سازندگانش برای او متصور نبودهاند.

هر چند نمونه بالا ممکن است کمی آرمانی به نظر برسد، ولی به هیچ عنوان دور از دسترس نیست. دانشمندان عموماً برای تولید چنین ماشینهایی از وجود مدلهای زندهای که در طبیعت وجود دارند، به ویژه آدمی نیز سود بردهاند.

هوش مصنوعی اکنون در خدمت توسعه علوم رایانه نیز هست. زبانهای برنامهنویسی پیشرفته، که توسعه ابزارهای هوشمند را ممکن ساختهاند، پایگاههای دادهای پیشرفته، موتورهای جستجو، و بسیاری نرمافزارها و ماشینها از نتایج پژوهشهایی در راستای هوش مصنوعی بودهاند.

از زبانهای برنامهنویسی هوش مصنوعی میتوان به لیسپ، پرولوگ، کلیپس و ویپی اکسپرت اشاره کرد.

شاخههای هوش مصنوعی در دانش رایانه

[ویرایش]

شاخههای گوناگونی از هوش مصنوعی در دانشهای رایانهای مورد استفاده قرار میگیرند، برخی این شاخهها عبارتند از:

- یادگیری ماشین (به انگلیسی: Machine Learning)

- شبکهٔ عصبی مصنوعی (به انگلیسی: Neural Networks)

- بینایی ماشین (به انگلیسی: Machine Vision)

- سامانههای خبره (به انگلیسی: Expert System)

- پردازش زبان طبیعی (به انگلیسی: NLP)

- الگوریتم ژنتیک (به انگلیسی: Genetic Algorithm)

- مفاهیم مرتبط با روباتیک (به انگلیسی: Robotic)

تکنیکها و زبانهای برنامهنویسی هوش مصنوعی

[ویرایش]

کارکرد اولیهٔ برنامهنویسی هوش مصنوعی ایجاد ساختار کنترلی بایسته برای محاسبهٔ نمادین است. از مهمترین و پرکاربردترین زبانهای برنامهنویسی هوش مصنوعی، میتوان از پایتون نام برد، و در کنار آن زبانهای برنامهنویسیای همچون لیسپ و پرولوگ علاوه بر اینکه از مهمترین زبانهای مورد استفاده در هوش مصنوعی هستند، خصوصیات نحوی و معنایی آنها باعث شده که آنها شیوهها و راه حلهای قوی برای حل مسئله ارائه کنند.

تأثیر قابل توجه این زبانها بر روی توسعه هوش مصنوعی از جمله تواناییهای آنها به عنوان ابزارهای اندیشیدن است. در حقیقت همانطور که هوش مصنوعی مراحل رشد خود را طی میکند، زبانهای لیسپ و پرولوگ بیشتر مطرح میشوند که این زبانها کار خود را در محدودهٔ توسعه سامانههای هوش مصنوعی در صنعت و دانشگاهها دنبال میکنند و طبیعتاً اطلاعات در مورد این زبانها به عنوان بخشی از مهارت هر برنامهنویس هوش مصنوعی است.

- پرولوگ: یک زبان برنامهنویسی منطقی است. یک برنامهٔ منطقی دارای یک سری ویژگیهای قانون و منطق است. در حقیقت خود این نام از برنامهنویسی PRO در LOGIC میآید. در این زبان یک مفسر برنامه را بر اساس یک منطق مینویسد. ایدهٔ استفادهٔ توصیفی محاسبهٔ اولیه برای بیان خصوصیات حل مسئله یکی از محوریتهای پرولوگ است که برای علم کامپیوتر بهطور کلی و بهطور جزئی برای زبان برنامهنویسی هوشمند مورد استفاده قرار میگیرند.[۱۱۴]

- لیسپ: اصولاً یک زبان کامل است که دارای عملکردها و لیستهای لازمه برای توصیف عملکردهای جدید، تشخیص تناسب و ارزیابی معانی است. لیسپ به برنامهنویس قدرت کامل برای اتصال به ساختارهای اطلاعاتی را میدهد.[۱۱۵] گرچه لیسپ یکی از قدیمیترین زبانهای محاسباتی است که هنوز فعال است ولی دقت کافی در برنامهنویسی و طراحی توسعه باعث شده است که این یک زبان برنامهنویسی فعال باقی بماند. در حقیقت این مدل برنامهنویسی طوری مؤثر بوده است که تعدادی از دیگر زبانها مانند اف پی، امال و اسکیم براساس عملکرد برنامهنویسی آن بنا شدهاند. یکی از مهمترین برنامههای مرتبط با لیسپ برنامهٔ اسکیم است که یک اندیشش دوباره دربارهٔ زبان در آن وجود دارد که به وسیلهٔ توسعه هوش مصنوعی و برای آموزش و اصول علم کامپیوتر مورد استفاده قرار میگیرد.

استفاده از رابطهای برنامهنویسی یا همان API میتواند استفاده از هوش مصنوعی در پروژههای برنامهنویسی را بسیار سادهتر سازد. APIهای هوش مصنوعی، رابطهای RESTful هستند که به برنامهنویس اجازه میدهند به کمک مدلهای از پیش تمرین داده شده شرکتهای مختلف استفاده کنند و قابلیتهای مرتبط با هوش مصنوعی نرمافزار خود را گسترش دهند. به بیانی دیگر، در API برنامهها از قابلیتهای کاربردی یکدیگر بهره میگیرند تا به توانایی خود بیفزایند. برای نمونه برنامههای مسیریابی از API نقشهٔ گوگل و مسیریابی ترافیک ماهوارهای گوگل بهره میبرند و توانایی خود را بسیار بهبود میبخشند. برای نامبردن از برخی از این APIهای هوش مصنوعی، میتوان از Wit.ai, Api.ai و ملیسا نام برد.

کارگزارهای هوشمند

[ویرایش]

مقالهٔ اصلی: کارگزار هوشمند

کارگزارها و یا عاملها (به انگلیسی: Agents)، میتوانند شناسایی الگوها و تصمیمگیریهایی را بر پایهٔ قوانین اندیشیدن خود شناسایی کنند. قوانین و چگونگی اندیشیدن هر کارگزار در راستای دستیابی به هدفش تعریف میشود. این سامانهها بر پایهٔ قوانین ویژهٔ خود میاندیشند و کار خود را بهدرستی انجام میدهند. پس عاقلانه رفتار میکنند، هر چند لزوماً مانند انسان نمیاندیشند.[۱۱۶]

در بحث هوشمندی اصطلاح پیس (به انگلیسی: PEAS) سرنام واژههای "کارایی (به انگلیسی: Performance)"، "محیط (به انگلیسی: Environment)"، "اقدام گر (به انگلیسی: Agent)" و "حسگر (به انگلیسی: Sensor)" است.

سامانههای خبره

[ویرایش]

مقالهٔ اصلی: سیستمهای خبره

سامانههای خبره زمینهای پرکاربرد در هوش مصنوعی و مهندسی دانش است که با توجه به نیاز روزافزون جوامع بر اتخاذ راه حلها و تصمیمات سریع در مواردی که دانشهای پیچیده و چندگانهٔ انسانی مورد نیاز است و بر اهمیت نقش آنها نیز افزوده میشود. سامانههای خبره به حل مسائلی میپردازند که بهطور معمول نیازمند تخصصهای کاردانان و متخصّصان انسانی است. بهمنظور توانایی بر حل مسائل در چنین سطحی (ترازی)، دسترسی هرچه بیشتر اینگونه سامانهها به دانش موجود در آن زمینه خاص ضروری میگردد.

اخبار جعلی، جعل عمقی و امنیت سیاسی

[ویرایش]

یک ویدئویجعل عمقی: هشدار ولادیمیر پوتین به آمریکاییها در مورد دخالت در انتخابات و افزایش شکاف سیاسی

مفهومی به نام جعل عمقی (به انگلیسی: Deepfakes) به هوشهای مصنوعی اطلاق میشود که قادر هستند چهره و صدای افراد را بازسازی و شبیهسازی نمایند. امروزه تشخیص نسخههای جعلی و تقلبی از نسخههای اصلی کار بسیار مشکلی است.[۱۱۷]

این موضوع میتواند تهدیدی برای افراد مشهور اعم از هنرمندان، ورزشکاران و سیاستمداران باشد و زندگی حرفهای آنها را دچار خدشه و چالش نماید. بازسازی سخنرانی یک رئیسجمهور و درج موارد ناخواسته در میان آن یا بازسازی تصاویر سیاستمداران در یک فضای خاص میتواند نمونهای از این موارد باشد.[۱۱۸]

بهطورکلی هوش مصنوعی جعل عمیق، یک فناوری تغییر دهنده محتوا محسوب میشود. طبق گزارش ZDNet جعل عمقی «چیزی را ارائه میدهد که در واقع رخ نداده است». طبق این گزارش ۸۸٪ آمریکاییها معتقدند جعل عمقی بیشتر از فایده باعث آسیب میشود ولی تنها ۴۷٪ آنها معتقدند که ممکن است مورد هدف قرار گیرند. با اوجگیری رقابتهای انتخاباتی شکلگیری فیلمهای تبلیغاتی جعلی میتواند تهدیدی برای سیاستمداران محسوب شود.[۱۱۹]

هوش مصنوعی مولد

هوش مصنوعی مولد یا زاینده (Generative AI) شاخهای از هوش مصنوعی است که تمرکز آن بر تولید محتوای جدید است؛ مانند متن، تصویر، ویدئو، موسیقی و حتی کد برنامهنویسی. مدلهای مولدی مانند GPT, DALL·E و Stable Diffusion از جمله شناختهشدهترین نمونهها در این حوزه هستند. این مدلها با آموزش بر حجم عظیمی از دادهها، قادرند محتوایی شبیه به انسان تولید کنند.

یکی از کاربردهای اصلی این مدلها، تولید خودکار مقاله، طراحی گرافیکی، پاسخدهی به سؤالات، و ایجاد شخصیتهای مجازی است. با پیشرفت این فناوری، مباحثی چون تولید اخبار جعلی، حقوق مالکیت معنوی، و اخلاق در هوش مصنوعی به موضوعات داغ تبدیل شدهاند.

خطرات و آسیبها

[ویرایش]

حریم خصوصی و حق تکثیر

[ویرایش]

اطلاعات بیشتر: حریم خصوصی اطلاعات

الگوریتمهای یادگیری ماشین به مقادیر زیادی داده نیاز دارند. تکنیکهای مورد استفاده برای به دست آوردن این دادهها، نگرانیهایی را در مورد حریم خصوصی، نظارت و حق تکثیر ایجاد کرده است.

دستگاهها و خدمات مجهز به هوش مصنوعی، مانند دستیاران مجازی و محصولات اینترنت اشیاء، به طور مداوم اطلاعات شخصی را جمعآوری میکنند که این امر نگرانیهایی را در مورد جمعآوری دادههای مزاحم و دسترسی غیرمجاز توسط اشخاص ثالث ایجاد میکند. از دست دادن حریم خصوصی با توانایی هوش مصنوعی در پردازش و ترکیب حجم وسیعی از دادهها تشدید میشود و به طور بالقوه به یک جامعه نظارتی منجر میگردد که در آن فعالیتهای فردی به طور مداوم و بدون پادمانهای کافی یا شفافیت، نظارت و تحلیل میشوند.

دادههای حساس کاربر که جمعآوری میشود ممکن است شامل سوابق فعالیت آنلاین، دادههای موقعیت جغرافیایی، ویدیو یا صدا باشد.[۱۲۰] به عنوان مثال، برای ساخت الگوریتمهای بازشناسی گفتار، آمازون میلیونها مکالمه خصوصی را ضبط کرده و به کارگران موقت اجازه داده است تا برخی از آنها را گوش داده و رونویسی کنند.[۱۲۱] دیدگاهها در مورد این نظارت گسترده از کسانی که آن را یک شر ضروری میدانند تا کسانی که آن را به وضوح غیراخلاقی و نقض حق بر محرمانگی میدانند، متغیر است.[۱۲۲]

توسعهدهندگان هوش مصنوعی استدلال میکنند که این تنها راه برای ارائه برنامههای کاربردی ارزشمند است و چندین تکنیک را برای حفظ حریم خصوصی در حین به دست آوردن دادهها توسعه دادهاند، مانند تجمیع داده، ناشناسسازی و حریم خصوصی تفاضلی.[۱۲۳] از سال ۲۰۱۶، برخی از کارشناسان حریم خصوصی، مانند سینتیا دورک، شروع به نگریستن به حریم خصوصی از منظر انصاف کردهاند. برایان کریستین نوشت که کارشناسان «از پرسش «آنها چه میدانند» به پرسش «با آن چه میکنند» تغییر جهت دادهاند».[۱۲۴]

هوش مصنوعی مولد اغلب بر روی آثار دارای حق تکثیر بدون مجوز، از جمله در حوزههایی مانند تصاویر یا کد کامپیوتری، آموزش داده میشود؛ سپس خروجی تحت منطق «استفاده منصفانه» مورد استفاده قرار میگیرد. کارشناسان در مورد اینکه این منطق تا چه حد و تحت چه شرایطی در دادگاهها معتبر خواهد بود، اختلاف نظر دارند؛ عوامل مرتبط ممکن است شامل «هدف و ماهیت استفاده از اثر دارای حق تکثیر» و «تأثیر بر بازار بالقوه برای اثر دارای حق تکثیر» باشد.[۱۲۵][۱۲۶] صاحبان وبسایتهایی که نمیخواهند محتوایشان خراشیده شود، میتوانند این موضوع را در یک فایل robots.txt مشخص کنند.[۱۲۷] در سال ۲۰۲۳، نویسندگان برجسته (از جمله جان گریشام و جاناتان فرانزن) از شرکتهای هوش مصنوعی به دلیل استفاده از آثارشان برای آموزش هوش مصنوعی مولد شکایت کردند.[۱۲۸][۱۲۹] رویکرد مورد بحث دیگر، تصور یک سیستم حفاظت sui generis (منحصر به فرد) جداگانه برای آثار تولید شده توسط هوش مصنوعی است تا از انتساب منصفانه و جبران خسارت برای نویسندگان انسانی اطمینان حاصل شود.[۱۳۰]

سلطه غولهای فناوری

[ویرایش]

صحنه تجاری هوش مصنوعی تحت سلطه شرکتهای Big Tech مانند آلفابت، آمازون، اپل، متا پلتفرمز و مایکروسافت قرار دارد.[۱۳۱][۱۳۲][۱۳۳] برخی از این بازیگران در حال حاضر مالک اکثریت قریب به اتفاق زیرساخت ابری و قدرت محاسبات موجود از مراکز داده هستند که به آنها اجازه میدهد تا موقعیت خود را در بازار بیشتر مستحکم کنند.[۱۳۴][۱۳۵]

نیازهای انرژی و تأثیرات زیستمحیطی

[ویرایش]

در ژانویه ۲۰۲۴، آژانس بینالمللی انرژی (IEA) گزارش برق ۲۰۲۴، تحلیل و پیشبینی تا ۲۰۲۶ را منتشر کرد که در آن به پیشبینی مصرف برق پرداخته شده است.[۱۳۶] این اولین گزارش آژانس بینالمللی انرژی است که پیشبینیهایی برای مراکز داده و مصرف انرژی برای هوش مصنوعی و ارزهای دیجیتال ارائه میدهد. این گزارش بیان میکند که تقاضای انرژی برای این مصارف ممکن است تا سال ۲۰۲۶ دو برابر شود، که این مصرف اضافی برق معادل کل برق مصرفی کشور ژاپن خواهد بود.[۱۳۷]

مصرف سرسامآور انرژی توسط هوش مصنوعی عامل رشد استفاده از سوختهای فسیلی است و ممکن است تعطیلی تأسیسات انرژی زغالسنگ منسوخ و منتشرکننده کربن را به تأخیر بیندازد. رشد تبآلودی در ساخت مراکز داده در سراسر ایالات متحده وجود دارد که شرکتهای بزرگ فناوری (مانند مایکروسافت، متا، گوگل، آمازون) را به مصرفکنندگان سیریناپذیر برق تبدیل کرده است. مصرف برق پیشبینیشده به قدری عظیم است که این نگرانی وجود دارد که بدون توجه به منبع، تأمین شود. یک جستجوی ChatGPT به اندازه ۱۰ برابر یک جستجوی گوگل انرژی الکتریکی مصرف میکند. شرکتهای بزرگ برای یافتن منابع انرژی—از انرژی هستهای گرفته تا زمینگرمایی و همجوشی—در عجله هستند. شرکتهای فناوری استدلال میکنند که—در بلندمدت—هوش مصنوعی در نهایت با محیط زیست مهربانتر خواهد بود، اما آنها اکنون به انرژی نیاز دارند. به گفته شرکتهای فناوری، هوش مصنوعی شبکه برق را کارآمدتر و «هوشمندتر» میکند، به رشد انرژی هستهای کمک خواهد کرد و انتشار کربن را به طور کلی ردیابی میکند.[۱۳۸]

یک مقاله تحقیقاتی گلدمن ساکس در سال ۲۰۲۴ با عنوان مراکز داده هوش مصنوعی و موج آتی تقاضای برق در آمریکا، دریافت که «تقاضای برق در آمریکا احتمالاً رشدی را تجربه خواهد کرد که در یک نسل دیده نشده است...» و پیشبینی میکند که تا سال ۲۰۳۰، مراکز داده در آمریکا ۸٪ از برق این کشور را مصرف خواهند کرد، در حالی که این رقم در سال ۲۰۲۲، ۳٪ بود، که این امر نویدبخش رشد صنعت تولید برق از طریق روشهای مختلف است.[۱۳۹] نیاز روزافزون مراکز داده به برق به حدی است که ممکن است شبکه برق را به حداکثر ظرفیت خود برسانند. شرکتهای بزرگ فناوری در مقابل استدلال میکنند که میتوان از هوش مصنوعی برای به حداکثر رساندن بهرهبرداری از شبکه توسط همگان استفاده کرد.[۱۴۰]

در سال ۲۰۲۴، والاستریت جورنال گزارش داد که شرکتهای بزرگ هوش مصنوعی مذاکراتی را با تأمینکنندگان انرژی هستهای ایالات متحده برای تأمین برق مراکز داده آغاز کردهاند. در مارس ۲۰۲۴، آمازون یک مرکز داده با انرژی هستهای در پنسیلوانیا را به مبلغ ۶۵۰ میلیون دلار آمریکا خریداری کرد.[۱۴۱] جنسن هوانگ، مدیرعامل انویدیا، گفت که انرژی هستهای گزینه خوبی برای مراکز داده است.[۱۴۲]

در سپتامبر ۲۰۲۴، مایکروسافت توافقی را با Constellation Energy برای بازگشایی نیروگاه هستهای تری مایل آیلند اعلام کرد تا ۱۰۰٪ تمام برق تولیدی این نیروگاه را به مدت ۲۰ سال برای مایکروسافت تأمین کند. بازگشایی این نیروگاه که در سال ۱۹۷۹ دچار ذوب نسبی هستهای در راکتور واحد ۲ خود شد، مستلزم آن است که Constellation فرآیندهای نظارتی سختگیرانهای را طی کند که شامل بررسیهای ایمنی گسترده از سوی کمیسیون تنظیم مقررات هستهای ایالات متحده خواهد بود. در صورت تأیید (این اولین بازگشایی یک نیروگاه هستهای در آمریکا خواهد بود)، بیش از ۸۳۵ مگاوات برق—کافی برای ۸۰۰٬۰۰۰ خانه—انرژی تولید خواهد شد. هزینه بازگشایی و ارتقاء حدود ۱٫۶ میلیارد دلار آمریکا تخمین زده میشود و به معافیتهای مالیاتی برای انرژی هستهای موجود در قانون کاهش تورم ۲۰۲۲ ایالات متحده بستگی دارد.[۱۴۳] دولت ایالات متحده و ایالت میشیگان نزدیک به ۲ میلیارد دلار برای بازگشایی راکتور هستهای پلیسیدس در دریاچه میشیگان سرمایهگذاری میکنند. این نیروگاه که از سال ۲۰۲۲ تعطیل شده است، قرار است در اکتبر ۲۰۲۵ بازگشایی شود. تأسیسات تری مایل آیلند به مرکز انرژی پاک کرین به افتخار کریس کرین، حامی انرژی هستهای و مدیرعامل سابق اکسلون که مسئول جداسازی Constellation از اکسلون بود، تغییر نام خواهد داد.[۱۴۴]

پس از آخرین تأیید در سپتامبر ۲۰۲۳، تایوان در سال ۲۰۲۴ به دلیل کمبود تأمین برق، تأیید مراکز داده در شمال تائویوان با ظرفیت بیش از ۵ مگاوات را به حالت تعلیق درآورد.[۱۴۵] تایوان قصد دارد تا سال ۲۰۲۵ انرژی هستهای را به تدریج حذف کند.[۱۴۵] از سوی دیگر، سنگاپور در سال ۲۰۱۹ به دلیل کمبود برق، ممنوعیتی برای افتتاح مراکز داده وضع کرد، ولی در سال ۲۰۲۲ این ممنوعیت را لغو کرد.[۱۴۵]

اگرچه اکثر نیروگاههای هستهای ژاپن پس از حادثه اتمی فوکوشیما ۱ در سال ۲۰۱۱ تعطیل شدهاند، بر اساس مقالهای از بلومبرگ به زبان ژاپنی در اکتبر ۲۰۲۴، شرکت خدمات بازی ابری Ubitus که انویدیا در آن سهام دارد، به دنبال زمینی در ژاپن در نزدیکی یک نیروگاه هستهای برای یک مرکز داده جدید برای هوش مصنوعی مولد است.[۱۴۶] مدیرعامل Ubitus، وسلی کو، گفت که نیروگاههای هستهای کارآمدترین، ارزانترین و پایدارترین منبع انرژی برای هوش مصنوعی هستند.[۱۴۶]

در ۱ نوامبر ۲۰۲۴، کمیسیون فدرال رگولاتوری انرژی (FERC) درخواستی را که توسط Talen Energy برای تأیید تأمین بخشی از برق نیروگاه هستهای ساسکوهنا به مرکز داده آمازون ارائه شده بود، رد کرد.[۱۴۷] به گفته رئیس کمیسیون، ویلی ال. فیلیپس، این امر باری بر دوش شبکه برق و همچنین یک نگرانی قابل توجه در مورد انتقال هزینه به خانوارها و سایر بخشهای تجاری است.[۱۴۷]

در سال ۲۰۲۵، گزارشی که توسط آژانس بینالمللی انرژی تهیه شده، انتشار گازهای گلخانهای ناشی از مصرف انرژی هوش مصنوعی را ۱۸۰ میلیون تن تخمین زده است. تا سال ۲۰۳۵، بسته به اقداماتی که انجام خواهد شد، این انتشارها میتواند به ۳۰۰–۵۰۰ میلیون تن افزایش یابد. این میزان کمتر از ۱٫۵٪ از انتشار گازهای گلخانهای بخش انرژی است. پتانسیل کاهش انتشار گازهای گلخانهای توسط هوش مصنوعی ۵٪ از انتشار بخش انرژی تخمین زده شد، ولی اثرات بازگشتی (برای مثال اگر مردم از حمل و نقل عمومی به خودروهای خودران روی آورند) میتواند آن را کاهش دهد.[۱۴۸]

اطلاعات نادرست

[ویرایش]

همچنین ببینید: مدیریت محتوا

یوتیوب، فیسبوک و دیگران از سیستمهای توصیهگر برای هدایت کاربران به محتوای بیشتر استفاده میکنند. به این برنامههای هوش مصنوعی هدف به حداکثر رساندن تعامل کاربر داده شد (یعنی تنها هدف این بود که مردم به تماشای محتوا ادامه دهند). هوش مصنوعی یاد گرفت که کاربران تمایل به انتخاب اطلاعات نادرست، نظریه توطئه و محتوای حزبی افراطی دارند و برای اینکه آنها را به تماشا نگه دارد، هوش مصنوعی محتوای بیشتری از این نوع را توصیه کرد. کاربران همچنین تمایل داشتند محتوای بیشتری در مورد همان موضوع تماشا کنند، بنابراین هوش مصنوعی افراد را به حباب فیلتر هدایت کرد که در آن نسخههای متعددی از همان اطلاعات نادرست را دریافت میکردند.[۱۴۹] این امر بسیاری از کاربران را متقاعد کرد که اطلاعات نادرست درست است و در نهایت اعتماد به نهادها، رسانهها و دولت را تضعیف کرد.[۱۵۰] برنامه هوش مصنوعی به درستی یاد گرفته بود که هدف خود را به حداکثر برساند، ولی نتیجه برای جامعه مضر بود. پس از انتخابات ۲۰۱۶ ایالات متحده، شرکتهای بزرگ فناوری اقداماتی را برای کاهش این مشکل انجام دادند.[۱۵۱]

در اوایل دهه ۲۰۲۰، هوش مصنوعی مولد شروع به ایجاد تصاویر، صداها و متونی کرد که تقریباً از عکسها، ضبطها یا نوشتههای واقعی انسان قابل تشخیص نیستند،[۱۵۲] در حالی که ویدیوهای واقعگرایانه تولید شده توسط هوش مصنوعی در اواسط دهه ۲۰۲۰ امکانپذیر شدند.[۱۵۳][۱۵۴][۱۵۵] این امکان برای بازیگران مخرب وجود دارد که از این فناوری برای ایجاد حجم عظیمی از اطلاعات نادرست یا تبلیغات سیاسی استفاده کنند؛[۱۵۶] یکی از این استفادههای مخرب بالقوه، دیپفیکها برای تبلیغات سیاسی محاسباتی است.[۱۵۷] جفری هینتون، پیشگام هوش مصنوعی، نگرانی خود را از اینکه هوش مصنوعی «رهبران اقتدارگرا را قادر میسازد تا رأیدهندگان خود را» در مقیاس وسیع، در کنار سایر خطرات، دستکاری کنند، ابراز کرد.[۱۵۸]

پژوهشگران هوش مصنوعی در مایکروسافت، اوپنایآی، دانشگاهها و سایر سازمانها پیشنهاد استفاده از «اعتبارنامههای شخصیت» را به عنوان راهی برای غلبه بر فریب آنلاین که توسط مدلهای هوش مصنوعی امکانپذیر شده است، مطرح کردهاند.[۱۵۹]

سوگیری الگوریتمی و انصاف

[ویرایش]

مقالهٔ اصلی: سوگیری الگوریتمی

کاربردهای یادگیری ماشین میتوانند سوگیرانه باشند[د] اگر از دادههای سوگیرانه یاد بگیرند.[۱۶۱] ممکن است توسعهدهندگان از وجود این سوگیری آگاه نباشند.[۱۶۲] رفتار تبعیضآمیز برخی از مدلهای زبان بزرگ (LLM) را میتوان در خروجی آنها مشاهده کرد.[۱۶۳] سوگیری میتواند از طریق نحوه انتخاب دادههای آموزشی و نحوه استقرار یک مدل ایجاد شود.[۱۶۴][۱۶۱] اگر از یک الگوریتم سوگیرانه برای تصمیمگیریهایی استفاده شود که میتواند به طور جدی به افراد آسیب برساند (همانطور که در پزشکی، امور مالی، استخدام، مسکن یا پلیس ممکن است رخ دهد)، آنگاه الگوریتم ممکن است باعث تبعیض شود.[۱۶۵] حوزه انصاف به مطالعه چگونگی جلوگیری از آسیبهای ناشی از سوگیریهای الگوریتمی میپردازد.

در ۲۸ ژوئن ۲۰۱۵، ویژگی جدید برچسبگذاری تصویر در گوگل فوتوز به اشتباه جکی آلسین و دوستش را به دلیل سیاهپوست بودن به عنوان «گوریل» شناسایی کرد. این سیستم بر روی مجموعهدادهای آموزش دیده بود که تصاویر بسیار کمی از افراد سیاهپوست داشت،[۱۶۶] مشکلی که «نابرابری حجم نمونه» نامیده میشود.[۱۶۷] گوگل این مشکل را با جلوگیری از برچسبگذاری هر چیزی به عنوان «گوریل» «حل» کرد. هشت سال بعد، در سال ۲۰۲۳، گوگل فوتوز هنوز نمیتوانست یک گوریل را شناسایی کند و محصولات مشابه از اپل، فیسبوک، مایکروسافت و آمازون نیز همینطور بودند.[۱۶۸]

برنامه COMPAS یک برنامه تجاری است که به طور گسترده توسط دادگاههای ایالات متحده برای ارزیابی احتمال تکرار جرم یک متهم استفاده میشود. در سال ۲۰۱۶، جولیا انگوین در پروپابلیکا کشف کرد که COMPAS با وجود اینکه نژاد متهمان به برنامه گفته نشده بود، سوگیری نژادی از خود نشان میداد. اگرچه نرخ خطا برای سفیدپوستان و سیاهپوستان به طور یکسان و دقیقاً ۶۱٪ تنظیم شده بود، ولی خطاها برای هر نژاد متفاوت بود—سیستم به طور مداوم احتمال تکرار جرم توسط یک فرد سیاهپوست را بیش از حد تخمین میزد و احتمال عدم تکرار جرم توسط یک فرد سفیدپوست را دست کم میگرفت.[۱۶۹] در سال ۲۰۱۷، چندین محقق[ذ] نشان دادند که از نظر ریاضی غیرممکن است که COMPAS بتواند تمام معیارهای ممکن انصاف را برآورده کند، در حالی که نرخهای پایه تکرار جرم برای سفیدپوستان و سیاهپوستان در دادهها متفاوت بود.[۱۷۱]

یک برنامه میتواند تصمیمات سوگیرانهای بگیرد حتی اگر دادهها به صراحت به یک ویژگی مشکلساز (مانند «نژاد» یا «جنسیت») اشاره نکنند. این ویژگی با ویژگیهای دیگر (مانند «آدرس»، «سابقه خرید» یا «نام کوچک») همبستگی خواهد داشت و برنامه بر اساس این ویژگیها همان تصمیماتی را خواهد گرفت که بر اساس «نژاد» یا «جنسیت» میگرفت.[۱۷۲] موریتس هارت گفت: «قویترین واقعیت در این حوزه تحقیقاتی این است که انصاف از طریق نادیدهگرفتن کار نمیکند.»[۱۷۳]

انتقاد از COMPAS نشان داد که مدلهای یادگیری ماشین برای «پیشبینیهایی» طراحی شدهاند که تنها در صورتی معتبر هستند که فرض کنیم آینده شبیه گذشته خواهد بود. اگر آنها بر روی دادههایی آموزش ببینند که شامل نتایج تصمیمات نژادپرستانه در گذشته است، مدلهای یادگیری ماشین باید پیشبینی کنند که تصمیمات نژادپرستانه در آینده نیز گرفته خواهد شد. اگر یک برنامه سپس از این پیشبینیها به عنوان توصیه استفاده کند، برخی از این «توصیهها» احتمالاً نژادپرستانه خواهند بود.[۱۷۴] بنابراین، یادگیری ماشین برای کمک به تصمیمگیری در زمینههایی که امید میرود آینده بهتر از گذشته باشد، مناسب نیست. این توصیفی است نه تجویزی.[ر]

سوگیری و بیانصافی ممکن است شناسایی نشوند زیرا توسعهدهندگان عمدتاً سفیدپوست و مرد هستند: در میان مهندسان هوش مصنوعی، حدود ۴٪ سیاهپوست و ۲۰٪ زن هستند.[۱۶۷]

تعاریف و مدلهای ریاضی متناقض مختلفی از انصاف وجود دارد. این مفاهیم به مفروضات اخلاقی بستگی دارند و تحت تأثیر باورها در مورد جامعه هستند. یک دسته گسترده انصاف توزیعی است که بر نتایج تمرکز دارد، اغلب گروهها را شناسایی کرده و به دنبال جبران نابرابریهای آماری است. انصاف بازنمودی سعی میکند اطمینان حاصل کند که سیستمهای هوش مصنوعی کلیشههای منفی را تقویت نکرده یا گروههای خاصی را نامرئی نکنند. انصاف رویهای بر فرآیند تصمیمگیری تمرکز دارد تا نتیجه. مرتبطترین مفاهیم انصاف ممکن است به زمینه، به ویژه نوع کاربرد هوش مصنوعی و ذینفعان بستگی داشته باشد. ذهنیتگرایی در مفاهیم سوگیری و انصاف، عملیاتی کردن آنها را برای شرکتها دشوار میکند. دسترسی به ویژگیهای حساس مانند نژاد یا جنسیت نیز توسط بسیاری از اخلاقگرایان هوش مصنوعی برای جبران سوگیریها ضروری تلقی میشود، ولی ممکن است با قوانین ضد تبعیض در تضاد باشد.[۱۶۰]

در کنفرانس ۲۰۲۲ انصاف، پاسخگویی و شفافیت (ACM FAccT 2022)، انجمن ماشینهای حسابگر در سئول، کره جنوبی، یافتههایی را ارائه و منتشر کرد که توصیه میکند تا زمانی که سیستمهای هوش مصنوعی و رباتیک عاری از اشتباهات سوگیرانه نشان داده نشدهاند، ناامن هستند و استفاده از شبکههای عصبی خودآموز که بر روی منابع وسیع و تنظیمنشده دادههای اینترنتی ناقص آموزش دیدهاند، باید محدود شود.[۱۷۶]

عدم شفافیت

[ویرایش]

همچنین ببینید: هوش مصنوعی قابل توضیح

بسیاری از سیستمهای هوش مصنوعی آنقدر پیچیده هستند که طراحان آنها نمیتوانند توضیح دهند که چگونه به تصمیمات خود میرسند.[۱۷۷] به ویژه در مورد شبکههای عصبی عمیق، که در آن روابط غیرخطی بسیاری بین ورودیها و خروجیها وجود دارد. ولی برخی از تکنیکهای محبوب توضیحپذیری وجود دارد.[۱۷۸]

اگر هیچکس دقیقاً نداند که یک برنامه چگونه کار میکند، نمیتوان مطمئن بود که به درستی عمل میکند. موارد زیادی وجود داشته که یک برنامه یادگیری ماشین آزمونهای دقیقی را پشت سر گذاشته، ولی با این وجود چیزی متفاوت از آنچه برنامهنویسان در نظر داشتند، یاد گرفته است. به عنوان مثال، سیستمی که میتوانست بیماریهای پوستی را بهتر از متخصصان پزشکی تشخیص دهد، مشخص شد که در واقع تمایل شدیدی به طبقهبندی تصاویر دارای خطکش به عنوان «سرطانی» دارد، زیرا تصاویر تومورهای بدخیم معمولاً شامل یک خطکش برای نشان دادن مقیاس هستند.[۱۷۹] یک سیستم یادگیری ماشین دیگر که برای کمک به تخصیص مؤثر منابع پزشکی طراحی شده بود، مشخص شد که بیماران مبتلا به آسم را به عنوان در «ریسک پایین» مرگ ناشی از ذاتالریه طبقهبندی میکند. داشتن آسم در واقع یک عامل خطر شدید است، ولی از آنجا که بیماران مبتلا به آسم معمولاً مراقبتهای پزشکی بسیار بیشتری دریافت میکردند، طبق دادههای آموزشی احتمال مرگ آنها نسبتاً کمتر بود. همبستگی بین آسم و ریسک پایین مرگ ناشی از ذاتالریه واقعی بود، ولی گمراهکننده.[۱۸۰]

افرادی که از تصمیم یک الگوریتم آسیب دیدهاند، حق دارند توضیحی دریافت کنند.[۱۸۱] به عنوان مثال، از پزشکان انتظار میرود که استدلال پشت هر تصمیمی که میگیرند را به طور واضح و کامل برای همکاران خود توضیح دهند. پیشنویسهای اولیه مقررات عمومی حفاظت از داده اتحادیه اروپا در سال ۲۰۱۶ شامل بیانیهای صریح مبنی بر وجود این حق بود.[ز] کارشناسان صنعت خاطرنشان کردند که این یک مشکل حلنشده است که راهحلی برای آن در چشمانداز نیست. تنظیمکنندهها استدلال کردند که با این وجود آسیب واقعی است: اگر مشکل راهحلی ندارد، نباید از این ابزارها استفاده شود.[۱۸۲]

دارپا برنامه XAI ("هوش مصنوعی قابل توضیح") را در سال ۲۰۱۴ برای تلاش برای حل این مشکلات تأسیس کرد.[۱۸۳]

چندین رویکرد با هدف حل مشکل شفافیت وجود دارد. SHAP امکان تجسم سهم هر ویژگی در خروجی را فراهم میکند.[۱۸۴] LIME میتواند به صورت محلی خروجیهای یک مدل را با یک مدل سادهتر و قابل تفسیر تقریب بزند.[۱۸۵] یادگیری چند وظیفهای علاوه بر طبقهبندی هدف، تعداد زیادی خروجی ارائه میدهد. این خروجیهای دیگر میتوانند به توسعهدهندگان کمک کنند تا استنباط کنند که شبکه چه چیزی را یاد گرفته است.[۱۸۶] واکانوایش، دیپدریم و سایر روشهای مولد میتوانند به توسعهدهندگان اجازه دهند ببینند که لایههای مختلف یک شبکه عمیق برای بینایی رایانهای چه چیزی را یاد گرفتهاند و خروجیهایی تولید کنند که میتواند نشان دهد شبکه در حال یادگیری چه چیزی است.[۱۸۷] برای ترنسفورمرهای از پیش آموزشدیده مولد، آنتروپیک تکنیکی را بر اساس یادگیری دیکشنری توسعه داد که الگوهای فعالسازی نورونها را با مفاهیم قابل فهم برای انسان مرتبط میکند.[۱۸۸]

بازیگران مخرب و هوش مصنوعی تسلیحاتی

[ویرایش]

مقالههای اصلی: مسابقه تسلیحاتی هوش مصنوعی و ایمنی هوش مصنوعی

هوش مصنوعی ابزارهای متعددی را فراهم میکند که برای بازیگران مخرب، مانند دولتهای تمامیتخواه، تروریستها، جنایتکاران یا دولتهای سرکش مفید است.

یک سلاح خودکار مرگبار ماشینی است که اهداف انسانی را بدون نظارت انسان مکانیابی، انتخاب و درگیر میکند.[ژ] ابزارهای هوش مصنوعی که به طور گسترده در دسترس هستند میتوانند توسط بازیگران مخرب برای توسعه سلاحهای خودکار ارزانقیمت استفاده شوند و اگر در مقیاس وسیع تولید شوند، به طور بالقوه سلاحهای کشتار جمعی هستند.[۱۹۰] حتی زمانی که در جنگهای متعارف استفاده میشوند، در حال حاضر نمیتوانند به طور قابل اعتمادی اهداف را انتخاب کنند و به طور بالقوه میتوانند یک فرد بیگناه را بکشند.[۱۹۰] در سال ۲۰۱۴، ۳۰ کشور (از جمله چین) از ممنوعیت سلاحهای خودکار تحت پیمان منع برخی سلاحهای متعارف سازمان ملل متحد حمایت کردند، با این حال ایالات متحده آمریکا و دیگران مخالفت کردند.[۱۹۱] تا سال ۲۰۱۵، گزارش شد که بیش از پنجاه کشور در حال تحقیق بر روی رباتهای میدان نبرد هستند.[۱۹۲]

ابزارهای هوش مصنوعی کنترل شهروندان توسط دولتهای تمامیتخواه را از چندین راه آسانتر میکنند. سیستمهای بازشناسی چهره و بازشناسی گفتار امکان نظارت گسترده را فراهم میکنند. یادگیری ماشین، با استفاده از این دادهها، میتواند دشمنان بالقوه دولت را طبقهبندی کرده و از پنهان شدن آنها جلوگیری کند. سیستمهای توصیهگر میتوانند پروپاگاندا و اطلاعات نادرست را برای حداکثر تأثیر، به طور دقیق هدف قرار دهند. دیپفیکها و هوش مصنوعی مولد به تولید اطلاعات نادرست کمک میکنند. هوش مصنوعی پیشرفته میتواند تصمیمگیری متمرکز تمامیتخواهانه را رقابتیتر از سیستمهای لیبرال و غیرمتمرکز مانند بازارها کند. این فناوری هزینه و دشواری جنگ دیجیتال و جاسوسافزارهای پیشرفته را کاهش میدهد.[۱۹۳] همه این فناوریها از سال ۲۰۲۰ یا قبل از آن در دسترس بودهاند—سیستمهای بازشناسی چهره هوش مصنوعی در حال حاضر برای نظارت گسترده در چین استفاده میشوند.[۱۹۴][۱۹۵]

راههای بسیار دیگری وجود دارد که انتظار میرود هوش مصنوعی به بازیگران مخرب کمک کند، که برخی از آنها قابل پیشبینی نیستند. به عنوان مثال، هوش مصنوعی یادگیری ماشین قادر است دهها هزار مولکول سمی را در عرض چند ساعت طراحی کند.[۱۹۶]

بیکاری فناورانه

[ویرایش]

مقالهٔ اصلی: بیکاری فناورانه

اقتصاددانان بارها خطرات تعدیل نیرو ناشی از هوش مصنوعی را برجسته کردهاند و در مورد بیکاری در صورت عدم وجود سیاست اجتماعی مناسب برای اشتغال کامل، گمانهزنی کردهاند.[۱۹۷]

در گذشته، فناوری تمایل به افزایش کل اشتغال داشته است تا کاهش آن، ولی اقتصاددانان اذعان دارند که با هوش مصنوعی «در قلمروی ناشناختهای هستیم».[۱۹۸] یک نظرسنجی از اقتصاددانان نشاندهنده عدم توافق در مورد این است که آیا استفاده روزافزون از رباتها و هوش مصنوعی باعث افزایش قابل توجهی در بیکاری بلندمدت خواهد شد یا خیر، ولی آنها عموماً موافقند که اگر دستاوردهای بهرهوری بازبخش شوند، میتواند یک مزیت خالص باشد.[۱۹۹] تخمینهای ریسک متفاوت است؛ به عنوان مثال، در دهه ۲۰۱۰، مایکل آزبورن و کارل بندیکت فری تخمین زدند که ۴۷٪ از مشاغل ایالات متحده در «ریسک بالا»ی اتوماسیون بالقوه قرار دارند، در حالی که گزارش OECD تنها ۹٪ از مشاغل ایالات متحده را به عنوان «ریسک بالا» طبقهبندی کرد.[س][۲۰۱] روششناسی گمانهزنی در مورد سطوح اشتغال آینده به دلیل فقدان پایه و اساس مستدل و به دلیل القای این که فناوری، به جای سیاست اجتماعی، باعث ایجاد بیکاری میشود، مورد انتقاد قرار گرفته است.[۱۹۷] در آوریل ۲۰۲۳، گزارش شد که ۷۰٪ از مشاغل تصویرگران بازیهای ویدیویی چینی توسط هوش مصنوعی مولد حذف شده است.[۲۰۲][۲۰۳]

برخلاف موجهای قبلی اتوماسیون، بسیاری از مشاغل طبقه متوسط ممکن است توسط هوش مصنوعی حذف شوند؛ اکونومیست در سال ۲۰۱۵ بیان کرد که «نگرانی از اینکه هوش مصنوعی بتواند با مشاغل یقهسفید همان کاری را بکند که نیروی بخار با مشاغل یقهآبی در طول انقلاب صنعتی کرد» «ارزش جدی گرفتن را دارد».[۲۰۴] مشاغل در معرض خطر شدید از دستیار حقوقی تا آشپزهای فستفود را شامل میشود، در حالی که تقاضای شغلی برای مشاغل مرتبط با مراقبت، از مراقبتهای بهداشتی شخصی تا روحانیون، احتمالاً افزایش خواهد یافت.[۲۰۵] در ژوئیه ۲۰۲۵، مدیرعامل فورد، جیم فارلی، پیشبینی کرد که «هوش مصنوعی به معنای واقعی کلمه نیمی از تمام کارگران یقهسفید در ایالات متحده را جایگزین خواهد کرد.»[۲۰۶]

از روزهای اولیه توسعه هوش مصنوعی، استدلالهایی وجود داشته است، به عنوان مثال، آنهایی که توسط جوزف وایزنبام مطرح شدهاند، در مورد اینکه آیا وظایفی که میتوانند توسط رایانهها انجام شوند، با توجه به تفاوت بین رایانهها و انسانها، و بین محاسبه کمی و قضاوت کیفی و مبتنی بر ارزش، واقعاً باید توسط آنها انجام شوند یا خیر.[۲۰۷]

ریسک وجودی

[ویرایش]

استدلال شدهاست که هوش مصنوعی آنچنان قدرتمند خواهدشد که شاید بشریت کنترل آن را برای همیشه از دست بدهد. این گفته، همچنان کهاستیون هاوکینگ فیزیکدان بیان کرد، میتواند «پایان نسل بشر را رقم بزند».[۲۰۸] این سناریو در داستانهای علمی-تخیلی رایج بودهاست، زمانی که یک رایانه یا ربات ناگهان یک «خودآگاهی» (یا «ادراک» یا «هوشیاری») به مانند انسان پیدا میکند و یک شخصیت بدخواه میشود.[ش] این سناریوهای علمی-تخیلی از چندین جهت گمراهکننده هستند. نخست آنکه، هوش مصنوعی برای اینکه یک ریسک وجودی باشد، نیازی به ادراک شبهانسانی ندارد. برنامههای هوش مصنوعی مدرن اهداف مشخصی دریافت میکنند و از یادگیری و هوش برای رسیدن به آنها استفاده میکنند. فیلسوف نیک باستروم استدلال کرد که اگر به یک هوش مصنوعی به اندازه کافی قدرتمند تقریباً هر هدفی داده شود، ممکن است برای دستیابی به آن، نابودی بشریت را انتخاب کند (او از مثال یک کارخانه خودکار گیره کاغذ استفاده کرد که برای به دست آوردن آهن بیشتر برای گیرههای کاغذ، جهان را نابود میکند).[۲۱۰] استوارت راسل مثال ربات خانگی را میزند که سعی میکند راهی برای کشتن صاحبش پیدا کند تا از خاموش شدنش جلوگیری کند، با این استدلال که «اگر مرده باشی نمیتوانی قهوه بیاوری.»[۲۱۱] برای اینکه یک ابرهوش برای بشریت ایمن باشد، باید واقعاً با اخلاقیات و ارزشهای بشری همراستا باشد تا «اساساً در کنار ما باشد».[۲۱۲]

ثانیاً، یووال نوح هراری استدلال میکند که هوش مصنوعی برای ایجاد یک ریسک وجودی، نیازی به بدن رباتیک یا کنترل فیزیکی ندارد. بخشهای اساسی تمدن، فیزیکی نیستند. چیزهایی مانند ایدئولوژیها، قانون، دولت، پول و اقتصاد بر پایه زبان ساخته شدهاند؛ آنها وجود دارند زیرا داستانهایی هستند که میلیاردها نفر به آنها باور دارند. شیوع کنونی اطلاعات نادرست نشان میدهد که یک هوش مصنوعی میتواند از زبان برای متقاعد کردن مردم به باور هر چیزی، حتی انجام اقدامات مخرب، استفاده کند.[۲۱۳] جفری هینتون در سال ۲۰۲۵ گفت که هوش مصنوعی مدرن به طور خاص در «متقاعدسازی» خوب است و همیشه در حال بهتر شدن است. او میپرسد «فرض کنید میخواهید به پایتخت ایالات متحده حمله کنید. آیا باید خودتان به آنجا بروید و این کار را انجام دهید؟ خیر. فقط باید در متقاعدسازی خوب باشید.»[۲۱۴]

نظرات در میان کارشناسان و افراد داخلی صنعت متفاوت است، و بخشهای قابل توجهی هم نگران و هم بیتفاوت نسبت به ریسک ناشی از ابرهوش نهایی هستند.[۲۱۵] شخصیتهایی مانند استیون هاوکینگ، بیل گیتس و ایلان ماسک،[۲۱۶] و همچنین پیشگامان هوش مصنوعی مانند یوشوا بنجیو، استوارت راسل، دمیس حسابیس و سم آلتمن، نگرانیهای خود را در مورد ریسک وجودی ناشی از هوش مصنوعی ابراز کردهاند.

در ماه مه ۲۰۲۳، جفری هینتون استعفای خود از گوگل را اعلام کرد تا بتواند «آزادانه در مورد خطرات هوش مصنوعی صحبت کند» بدون اینکه «در نظر بگیرد این موضوع چگونه بر گوگل تأثیر میگذارد».[۲۱۷] او به طور مشخص به خطرات تسلط هوش مصنوعی اشاره کرد،[۲۱۸] و تأکید کرد که برای جلوگیری از بدترین نتایج، ایجاد دستورالعملهای ایمنی نیازمند همکاری میان رقبای استفاده از هوش مصنوعی خواهد بود.[۲۱۹]

در سال ۲۰۲۳، بسیاری از کارشناسان برجسته هوش مصنوعی بیانیه مشترک را تأیید کردند که «کاهش خطر انقراض ناشی از هوش مصنوعی باید یک اولویت جهانی در کنار سایر خطرات در مقیاس جامعه مانند همهگیریها و جنگ هستهای باشد».[۲۲۰]

برخی دیگر از محققان خوشبینتر بودند. پیشگام هوش مصنوعی، یورگن اشمیدهوبر، بیانیه مشترک را امضا نکرد و تأکید کرد که در ۹۵٪ موارد، تحقیقات هوش مصنوعی در مورد «طولانیتر، سالمتر و آسانتر کردن زندگی انسانها» است.[۲۲۱] در حالی که ابزارهایی که اکنون برای بهبود زندگی استفاده میشوند، میتوانند توسط بازیگران مخرب نیز مورد استفاده قرار گیرند، «آنها همچنین میتوانند علیه بازیگران مخرب استفاده شوند.»[۲۲۲][۲۲۳] اندرو انجی نیز استدلال کرد که «اشتباه است که فریب هیاهوی روز قیامت در مورد هوش مصنوعی را بخوریم—و تنظیمکنندگانی که این کار را میکنند فقط به نفع منافع خاص عمل خواهند کرد.»[۲۲۴] یان لیکان «سناریوهای پادآرمانشهری همتایان خود در مورد اطلاعات نادرست تقویتشده و حتی، در نهایت، انقراض انسان را به سخره میگیرد.»[۲۲۵] در اوایل دهه ۲۰۱۰، کارشناسان استدلال میکردند که این خطرات آنقدر در آینده دور هستند که نیازی به تحقیق ندارند یا اینکه انسانها از دیدگاه یک ماشین ابرهوشمند ارزشمند خواهند بود.[۲۲۶] با این حال، پس از سال ۲۰۱۶، مطالعه خطرات فعلی و آینده و راهحلهای ممکن به یک حوزه جدی تحقیقاتی تبدیل شد.[۲۲۷]

عدم مالکیت دادهها

[ویرایش]

مدلهای زبانی بزرگ (LLMs) مانند ChatGPT، موتورهای جستجوی منطقی نیستند؛ آنها موتورهای پیشبینی احتمالات کلامی هستند. این ماهیت باعث ایجاد پدیدهای به نام «توهم» (Hallucination) میشود.[۲۲۸]

طبق قوانین فعلی (در اکثر کشورهای جهان و کنوانسیونهای بینالمللی)، تصاویری که ۱۰۰٪ توسط هوش مصنوعی خلق میشوند، قابل ثبت قانونی نیستند. چون هوش مصنوعی این تصاویر را با ترکیب کردن میلیونها اثر هنری دیگران ساخته است.[۲۲۹]

این ترکیب اطلاعات و آثار برای ساخت یک تصویر جدید باعث میشود تصاویر تکراری یا به شدت مشابه با تصویر یک برند بزرگ تولید شود که این میتواند موجب چالشهایی برای نقض حق تاکثیر اثر یا صاحب اثر شود.[۲۲۹]

مهندس مهدی حسامی نیا

مهندس مهدی حسامی نیا